从概念萌芽到大模型普惠 人工智能发展史入门与基础软件开发

人工智能(AI)作为一门新兴且飞速发展的技术,其发展历程波澜壮阔,从哲学思辨到实验室原型,再到如今深刻融入我们生活的大模型时代。理解其完整脉络,对于掌握其核心并投身于基础软件开发至关重要。

第一阶段:概念萌芽与早期探索(1950年代前)

人工智能的思想源远流长。在古代神话和哲学中,创造具有智慧的“人造物”的梦想就已存在。但作为一门现代学科,其直接奠基始于20世纪中叶。

- 理论基础:1943年,沃伦·麦卡洛克和沃尔特·皮茨提出了第一个人工神经元模型(MCP模型),为神经网络奠定了基础。艾伦·图灵在1950年发表了划时代的论文《计算机器与智能》,提出了著名的“图灵测试”,为衡量机器智能设立了标准。

- 学科诞生:1956年,在达特茅斯会议上,约翰·麦卡锡、马文·明斯基等科学家首次正式提出了“人工智能”这一术语,标志着AI作为一门独立学科的诞生。

这一时期的特点是思想活跃、理论先行,但受限于计算能力,实践探索多为简单的定理证明和游戏程序。

第二阶段:起伏与积累(1950s-1990s)

这一阶段AI经历了“乐观—失望—复兴”的多次循环,被称为“三起两落”。

- 第一次浪潮(推理与搜索):早期AI聚焦于利用逻辑和规则来模拟人类推理(符号主义),开发了能解决代数问题、证明几何定理的程序。但很快人们发现,许多人类凭直觉能轻易处理的问题(如视觉识别、自然语言理解),机器却难以用规则穷尽,导致了第一次“AI寒冬”。

- 第二次浪潮(知识工程与专家系统):研究者转向构建包含大量人类专业知识的“专家系统”,在特定领域(如医疗诊断、化学分析)取得成功。知识获取的瓶颈和维护的困难,加之计算能力的限制,再次使AI陷入低潮。

- 静默突破:在此期间,连接主义(神经网络)的研究在低谷中持续。反向传播算法的完善(1986年)为神经网络的训练提供了有效方法,为未来的爆发埋下了种子。

第三阶段:数据驱动与深度学习崛起(2000s-2010s)

进入21世纪,三大引擎的汇聚点燃了AI的第三次、也是最持久的一次浪潮:

- 海量数据:互联网的普及产生了前所未有的数据量。

- 强大算力:GPU等硬件的发展提供了并行计算的巨大能力。

- 核心算法:深度学习算法(尤其是深度神经网络)在理论和工程上取得关键突破。

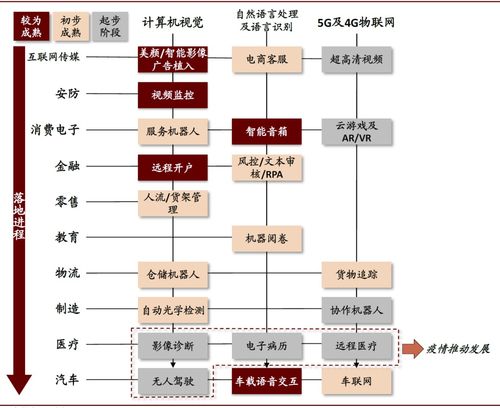

2012年,AlexNet在ImageNet图像识别竞赛中以压倒性优势夺冠,标志着深度学习时代的正式开启。AI在计算机视觉、语音识别、自然语言处理等领域开始全面超越传统方法,并迅速产品化。

第四阶段:大模型与普惠化时代(2020s至今)

当前,我们正处在以大模型(Large Language Models, LLMs)和生成式AI为主导的新阶段。

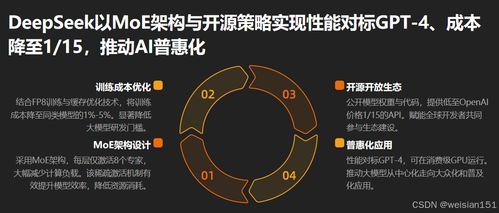

- 范式转变:从针对特定任务的“小模型”,转向通过海量数据预训练、能处理多种任务的“基础模型”。以GPT、BERT等为代表的模型,展现了惊人的泛化、理解和生成能力。

- 技术特征:模型参数规模急剧膨胀(从亿级到万亿级),训练成本高昂,但带来了“涌现能力”——即模型在达到一定规模后,展现出未在训练中明确设定的新能力。

- 普惠化:通过API(应用程序接口)、开源模型(如Llama系列)和云服务,大模型的能力正以前所未有的低门槛向开发者、企业和公众开放。AI不再是实验室的专属,而是成为了人人可用的“基础设施”。

人工智能基础软件开发:连接历史与未来

了解历史脉络,能让我们更好地把握当下AI开发的精髓。现代AI基础软件开发的核心已发生深刻变化:

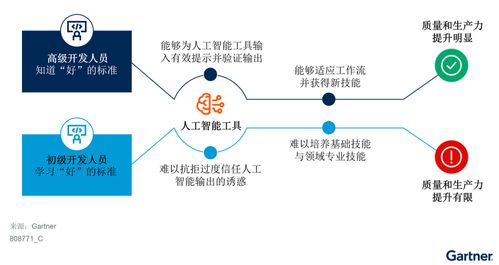

- 开发范式的迁移:从“从零开始编写算法和规则”转向“基于预训练模型进行微调、提示工程和应用开发”。开发者更像是一个“AI能力的调校者和组装者”。

- 核心技能栈:

- 数学与算法基础:线性代数、概率论、微积分及机器学习基本算法仍是理解模型的基石。

- 编程与框架:Python是绝对主流。熟练掌握PyTorch、TensorFlow等深度学习框架,以及Hugging Face等模型生态工具。

- 数据处理能力:数据收集、清洗、标注和管理的能力至关重要。

- 模型理解与工程:理解模型架构(如Transformer),掌握模型微调、压缩、部署和服务的全流程(MLOps)。

- 提示工程与评估:对于大模型应用,如何设计有效的提示词(Prompt)以及如何评估模型输出质量,成为关键技能。

- 关注点变化:除了追求模型精度,开发效率、计算成本、可解释性、公平性、安全性和合规性成为同等重要的考量因素。

****

人工智能的发展史,是一部人类不断拓展认知边界、将智慧外化为技术的史诗。从最初的逻辑推理到今天的感知与创造,每一次飞跃都建立在理论与工程的双重突破之上。如今,我们站在大模型普惠化的起点,AI基础软件开发的门槛降低,但创新的天花板被极大地抬高。对于开发者而言,深入理解这段历史,不仅是为了知晓从何而来,更是为了清晰地判断向何处去,从而在AI赋能千行百业的浪潮中,构建出真正智能和有用的未来。

最新产品

总编来了!看数字经济如何点亮玄武 人工智能基础软件开发

聂清副校长带队调研人工智能基础软件开发,深化校企合作,共谋人才培养新篇章

未来五年,人工智能基础软件开发 新职业浪潮中的机遇与挑战

模块化工厂软件与机器人融合 人工智能基础软件开发如何将汽车生产效率提升30%

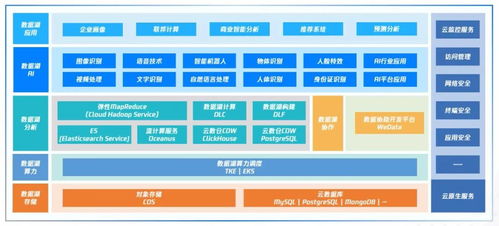

腾讯云发布国内首个云原生智能数据湖产品图谱,夯实人工智能基础软件开发基石

在中国构建AI软件工程技能的三大战略举措 聚焦人工智能基础软件开发

人工智能基础软件开发的要点与挑战

人工智能发展潜力与基础软件开发的监管之路

2020智能教育发展蓝皮书 人工智能如何通过基础软件开发助力因材施教

中金 后疫情时代人工智能的发展趋势——聚焦基础软件开发